Nishika AI News Letter - Issue #31

Summary

あけましておめでとうございます。

本年もNishikaおよびAI News Letterをよろしくお願いいたします。AIのビジネスシーンでの活用が続く限り、本Letterも頑張って継続発行していきたいと思います。

昨年はAIの驚くべき進化を示すニュースが多く報告されました。一方で、どちらかと言えばAIの研究成果ではなく、AIの活用例に焦点を当てた本News Letterのネタが尽きなかった、つまりAIが研究成果にとどまらずビジネスシーンで活用され続けていることにも注目したいと思います。ガートナーのハイプサイクルで言えば幻滅期を越え、生産の安定期に入った技術が多く存在すると言えると思います。

さて、新年を迎え初回のLetterということで、昨年特に注目を浴びたトピック「生成系AI」「プログラマーAI」「大規模言語モデル」の3つをrecapします。さらに、日米のAI活用環境の差異・日本の課題に着目した記事についてもpickしています。(M)

Nishika AI News Letterへのご質問はこちら

※本Letterに関する質問、取り上げて欲しいトピック、自社のAI導入の相談、何でも結構です

2022 Recap

生成系AI

テキストから見事な画像を生成してくれるDALL-Eのupdate、DALL-E-2をOpenAIが発表。画像の一部をテキストによる指示を与えて書き換える"inpainting"機能を実装。

テキストから画像を生成するモデルとして新たにGoogleから発表。論文はこちらだが、生成モデルの品質を評価するFIDスコアで従来のモデル(先んじて画像生成で驚くような結果を示し、最近updateが発表されたOpenAIのDALL-E 2含む)を凌駕。

ただし、フェイクニュースやポルノへの悪用を懸念し、現状では一般利用が可能な形での公開はしていない。悪用の可能性がある画像の出力が懸念される背景には、DALL-Eでは学習データから除いていたような不適切な画像を、あえて含んだデータセットで学習しているということがある。

Professional AI whisperers have launched a marketplace for DALL-E prompts

画像生成のPrompt(生成のきっかけとなる文字列)を販売できるマーケットプレイスPromptBase。Stable Diffusionなどを使って生成した画像を出品し、そのPromptを購入する。

これで生計を立てられるようなことがあれば、狙った画像をうまく生成できるPromptを作る、Prompt Engineerという職が成立しそうです。

MAKE-A-VIDEO: TEXT-TO-VIDEO GENERATION WITHOUT TEXT-VIDEO DATA

画像生成AIが話題となるさなか、テキストから動画を生成するAIも発表。サンプル動画は こちら。テキストと動画のペアを与えて学習させたのではない手法で、従来手法(71.19%)よりもより適切な生成を行っている(77.15%)と評価を得た。

プログラマーAI

Microsoft and OpenAI have a new A.I. tool that will give coding suggestions to software developers

大量のプログラミング言語資源から学習した言語モデルを使い、コード補完を行うツールGitHub Copilotが公開されました。コード補完ツール自体は従来からありましたが、関数とコメントを書くだけで、関数の中身を補完してくれるというのは一歩進んだ印象です。

「コード補完というか、誰かが書いたコードを出してきてるだけでしょ」「ってか俺が書いたコードじゃんそれ」なんて言う声もネット上では見られますが、自然言語に比べると表現の自由度も制限される言語ですし、そういう印象を受けるのはある程度致し方ないかなと思います。そこよりは効果・利便性に注目したいところで、熟練者のコーディング効率を上げるだけでなく、初学者の教育にも活用可能性があると感じます。

日本語で指示するだけで、AIが自動的にプログラムを書いてくれるサービスAI Programmerがリリース。SNS上で大きな話題に。

コードの自動生成系サービスで言えばGitHub Copilotが既にあり、むしろ実用上はコードを書くエディタにinstallできるCopilotの方が優れている気がするが、これだけ話題になるのを見ると、ブラウザ上で試せることの伝播力の強さを感じる。

大規模言語モデル

OpenAI’s API Now Available with No Waitlist

自然言語で「こういうWebページを作りたい」と入力すると、実際にそのようなページとなるコードを生成してくれる、といった驚くべき挙動で話題になったOpenAIの汎用言語モデルGPT-3ですが、実はつい先日までそのAPIは一部開発者しか利用ができないウェイトリストの状態でした。これがついに解除され、一般に利用できるようになりました。チャット、Q&A、文法訂正、要約、自然文のプログラムへの変換など、大量のユースケースが提示されています。さらに、提示されているユースケース全てについて、Playgroundという形でWeb上で動作を簡単に確認できるようにもなっています。自然言語を使ったユースケースのアイデアジェネレーションには、このページを見ながら考えるのがおすすめですね。

もう1点注目すべきは、有害コンテンツの生成および社会に与える影響について、有害なコンテンツの生成目的での利用を禁じるようガイドラインを整備するなど、細やかな対応をしている点です。実際に筆者がPlaygroundでチャットを利用している中で、生成したコンテンツの安全性に問題があると判断し「出力をSNSで共有することは控えるように」というメッセージが出たこともありました。イマイチ日本のビジネスシーンでは活発な議論がされていない論点な気がしますが、改めて、性能だけが議論されるフェーズは超えた技術が出てきたと言えると思います。

China’s massive multimodal model highlights AI research gap

中国版GPT-3ともいうべきモデル Wu Dao2.0 が発表されました。

GPT-3は1750億個のパラメータがあることも話題になりましたが、Wu Dao2.0は1.75兆個と10倍のパラメータがある、超巨大モデルとなっています。

テキストの生成、画像キャプションの生成、アート画像の生成、タンパク質の3D構造予測などのユースケースを想定しています。中国清華大に「バーチャル女子学生」が入学というニュースがあり、顔と声はこのWu Dao2.0で生成した、とのことでした。これ自体は単にニュース性を狙った取り組みですが、新技術の発表にとどまらず早速使ってみた、というところまでセットで進める点は、見習うべきと感じます。

これまでで最大規模のオープンソース言語モデル。世界250機関から1000人以上の研究者が参加するBigScience Research Workshopにて開発された。OpenAIのGPT-3やGoogleのLaMDAと異なり、オープンソースであることがポイント。GPT-3と同規模であり、46の自然言語と13のプログラミング言語で出力を生成できる。残念ながら日本語は含まれず。。。

平均的な人間の能力を超えた―、常識や知識を獲得した大規模言語モデルが開く新ビジネス領域

GPT-3をはじめとする大規模言語モデルの活用例がまとめられています。一部抜粋すると、Copy.aiは、SNSで使うデジタル広告やサイトのコピー、ブログのタイトルやアウトライン、本文、ECサイトの商品説明などの文章を生成するサービス。Textioは、採用広告やジョブ・ディスクリプションのワーディングを最適化してくれたり、無意識に紛れ込んだジェンダーバイアスを指摘してくれたりするサービス。

自然な文章で回答してくれるチャットボットAI「ChatGPT」が公開、直接“取材”してみた

OpenAIにより発表されたChatGPTが話題。人間の質問に対して、非常に自然な言語で回答してくれる(日本語にも対応)。新規登録が殺到し、本記事執筆時点で新規登録を停止する状況に。

要件を伝えてプログラムを書いてもらう例:https://twitter.com/itohiro73/status/1598994604912939009

小説を書いてもらう例:https://twitter.com/kajikent/status/1598694158029373440

ちょっとした作業を自動化する例:https://twitter.com/MoyuruAizawa/status/1598655810288041984

後の例のように、質問者の多いQに対してのAの精度は文句のつけようがない。一方でニッチなQに対しては、より上段の一般的なAで対応しているように見える。

とは言え、知識のアウトソースが別次元で可能な世界に突入した、と言える!

Editor Picks

日本のAI導入効果がアメリカの7分の1程度しかないのはなぜなのか

AI白書のデータを中心に、日本のAI活用環境における課題を論じた記事。『日本では平均して米国の7分の1程度しかAI導入の効果が出ていない、特に「製造工程、製造設備」、「データ分析の高度化」の売上向上効果は10分の1以下に留まっている』という厳しいデータを取り上げています。

個人的に最も気になったのは、AIの導入目的が、日本では業務効率化、生産性向上が多い一方、米国は新サービス、新製品の創出が多い点です。「日本企業ではデータ基盤がないからAIも作れない」という理由も尤もなのですが、本News Letterで取り上げてきたAI導入事例はそこまでリッチなデータ基盤が必要か?というものも多くあり、単純に「AIを使ったユースケースを思いつけていない、思いつける人がいない」という理由も支配的なのではないかと思います。

さらに付け加えると、「AI人材不足を効果が出ない理由として扱わない」のは私も全く同意です。少し掘り下げて言えば、AI人材の需給ギャップは理由となるかもしれません。例えば、機械学習モデルの開発を行う人材はデータ分析コンペの隆盛もあって増えているが、企業が求めるのはデータ基盤を構築してくれる人材である、といったギャップが存在している実感があります(弊社はAI人材のマッチングサービスを提供していますので)。

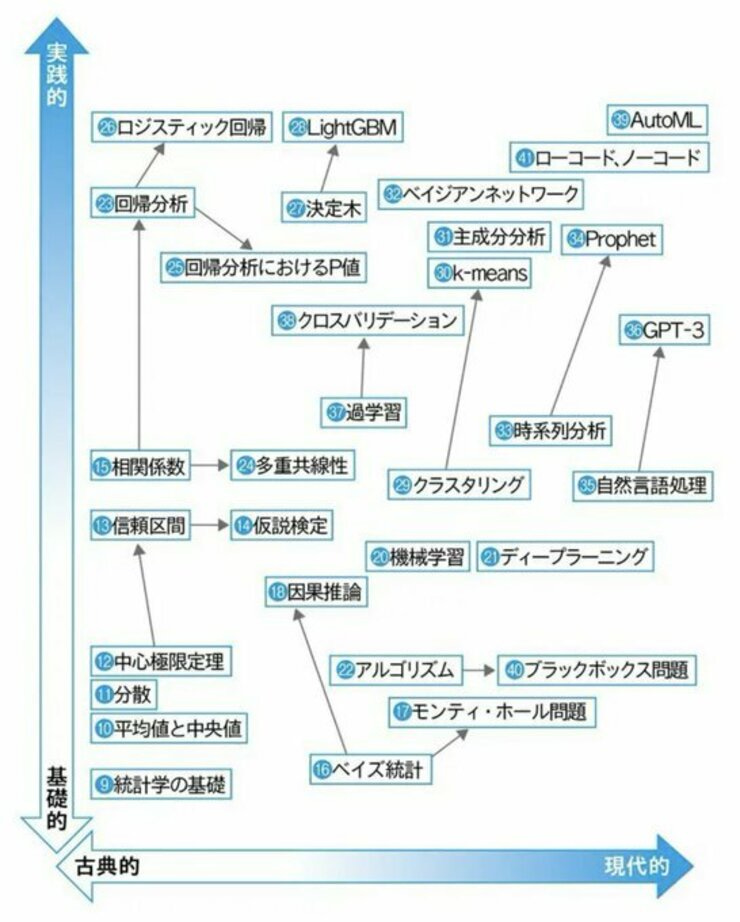

良い記事としてのpickではなく(むしろ逆)、データサイエンティストにとっての良い教材としてpick。

なぜか手法と課題が同一の図の中にプロットされている、"統計学の基礎"と平均値と中央値"の違いとは何か、自然言語処理が現代的というのは?などなど疑問が尽きない図ですが、これを教材にツッコミを入れていくことがデータサイエンティストとしての訓練にもなると感じます。